AI正逐步走進普羅大眾生活,但專家擔心帶來的隱憂。(美聯社)

人工智能(AI)已由以前的科幻電影構想,快速走進生活,連長者隨時都懂得「每事問AI」。由翻譯開始,人們慢慢利用AI輔助撰寫郵件、工作資料、研究論文,甚至作重要決策。中美近期均有研究指,在AI愈趨「無孔不入」的人機合一年代,人們須警惕勿過分倚賴AI,輕則失業、重則腦霧,並給出值得參考的建議。

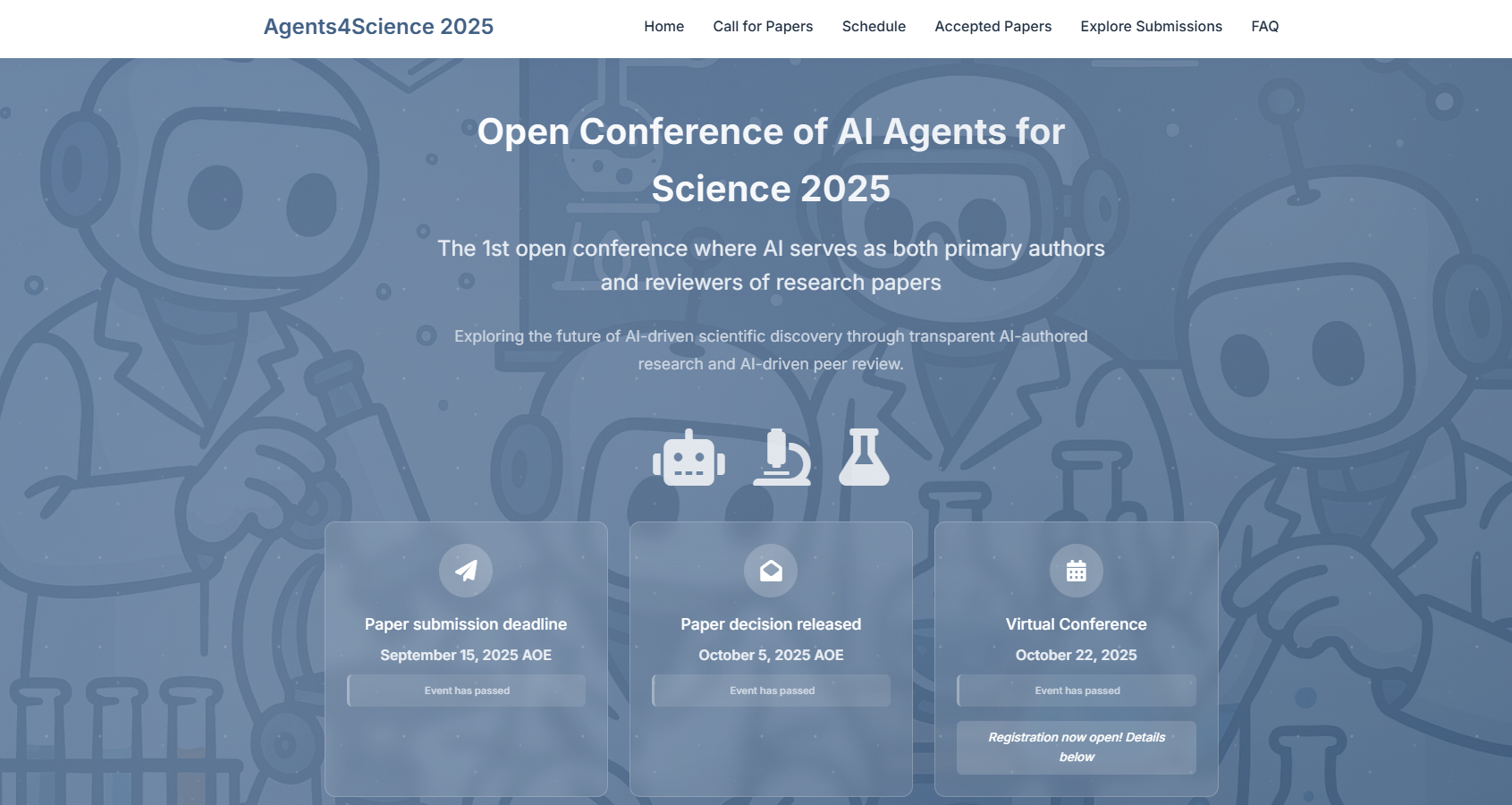

全球首場「AI論文」會議

美國史丹福大學研究人員早前策劃了全球首場專門探討AI科學論文的線上會議「Agents4Science 2025」,所有提交的論文,主要作者必須是AI。會議旨在探討AI能否及如何獨立產生新穎的科學見解、假設與方法論證等。

會議有何結論呢?其中加州大學柏克萊分校一位經濟學家及團隊,與AI合作研究三藩市的拖車數據。她大讚AI在協助運算方面幫了很大忙,但直言「與AI合作時要非常小心」,指AI曾「引用錯誤日期」,須人手更正。另一位天文物理學家看過多篇「AI論文」後,指技術上大部分也正確,「但它們(論文)既不有趣亦不重要」。她對AI在科研究領域的潛力感興奮,但不認為目前的AI能「設計出嚴謹的科學問題」。

AI的「幻覺」隨時寫入論文

荷蘭阿姆斯特丹大學研究人員皮爾遜表示,AI推動了科研進程,如可用於繪製蛋白質結構、研發新型抗生素,也能加快探討文獻等環節進度;但指AI有時會產生「幻覺」,並將之寫入論文或研究,令人非常擔憂。他並稱,AI的受訓練數據可能蘊含偏見,導致AI或成為加劇種族及性別等不平等問題的「幫兇」。

律師都被騙 AI虛假案例被呈堂

AI大模型「開箱即用」的便利性降低了使用門檻,不少用戶對AI的缺陷認知不足,容易輕信AI,連律師都中招。英國高等法院今年6月要求律師採取緊急行動,防止AI被濫用,原因是有幾份可能由AI生成的虛假案例被呈堂。另外,早前一份由美國衛生與公眾服務部牽頭、「讓美國再次健康」委員會發布的兒童慢性病報告,也因使用了生成式AI內容而出現重大引用錯誤。

專家建議AI強制彈出「驗證提示」

有研究人員建議,開發者在設計生成式AI工具時,應要有提醒用戶保持批判性思考的設定,如提供需驗證的場景。例如在涉及法律及醫療建議等高風險任務時,應強制彈出「驗證提示」,叫用戶「請核對AI所引用的法規條款」等,主動向用戶提出潛在風險,別讓用戶認為AI「全知全能」、不會出錯。

美國史丹福大學早前舉辦了一場檢視「AI論文」會議。(互聯網)

人們之所以愈加依賴AI,全因近年來AI能力及便利性大幅飛躍。AI生成內容的專業化程度,讓不少人奉為專家,跟AI對話,隨時覺得它就像一位學識淵博又無所不談的老友,形成心理依賴。

內地浙江大學管理學院吳蘇青團隊,早前在英國科學期刊《科學報告》(Scientific Reports)發表研究報告,指人們使用AI可能會導致自己「空心化」——把工作最「燒腦」的部分交由AI完成,人類則只剩機械式工作,這可能影響心理及喪失工作動力,建議企業及政府部門等部署AI時要「放慢腳步」,應先作小範圍嘗試、可控地推進,一邊觀察對員工積極性和創造力的影響。

過度依賴AI模型或致「腦霧」

另有新研究顯示,過度依賴AI模型或致「AI腦霧」,削弱工作動力。其中美國麻省理工大學的研究發現,長期使用AI會導致認知能力下降。研究人員對受試者展開腦電圖掃描,發現與沒有使用AI工具的人相比,長期使用AI大語言模型的人,大腦神經連接數降低,影響語言和行為等層面。微軟公司和卡內基梅隆大學的研究,也有類似發現,指生成式AI會削弱批判性思維能力,導致過度依賴,可能削弱人們獨立解決問題的能力。

「把判斷力也一起外包了」

科幻作家、中國作協科幻文學委員會副主任陳楸帆慨嘆「我們在使用AI的同時,把判斷力也一起外包了」。他指用家往往不再去驗證AI給出的答案,不再去反思使用AI的過程,「無條件接受AI給的任何信息,就會導致人的主觀能動性下降,深度的閱讀思考和表達能力也會隨之退化。」

「AI乘客」及「AI駕駛者」

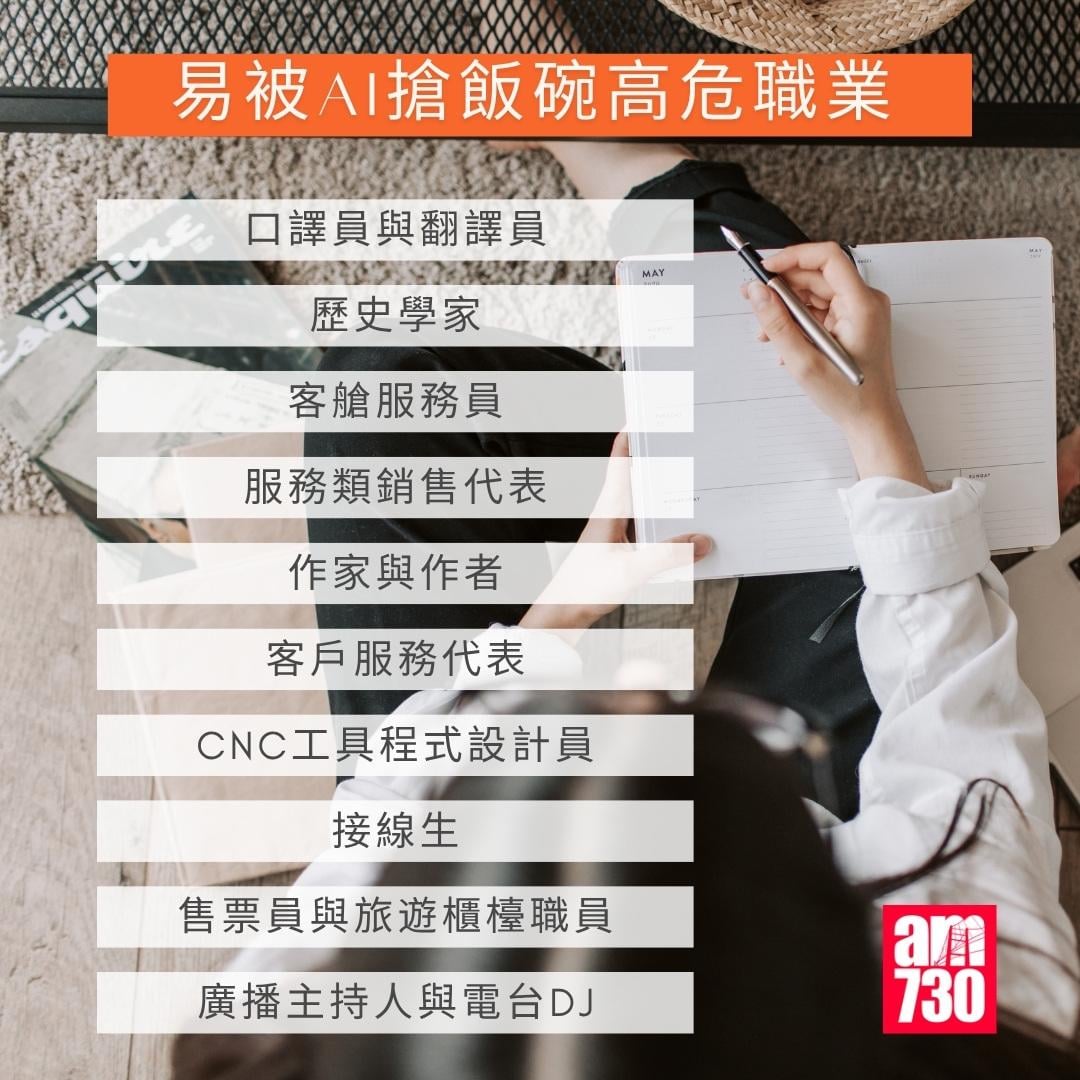

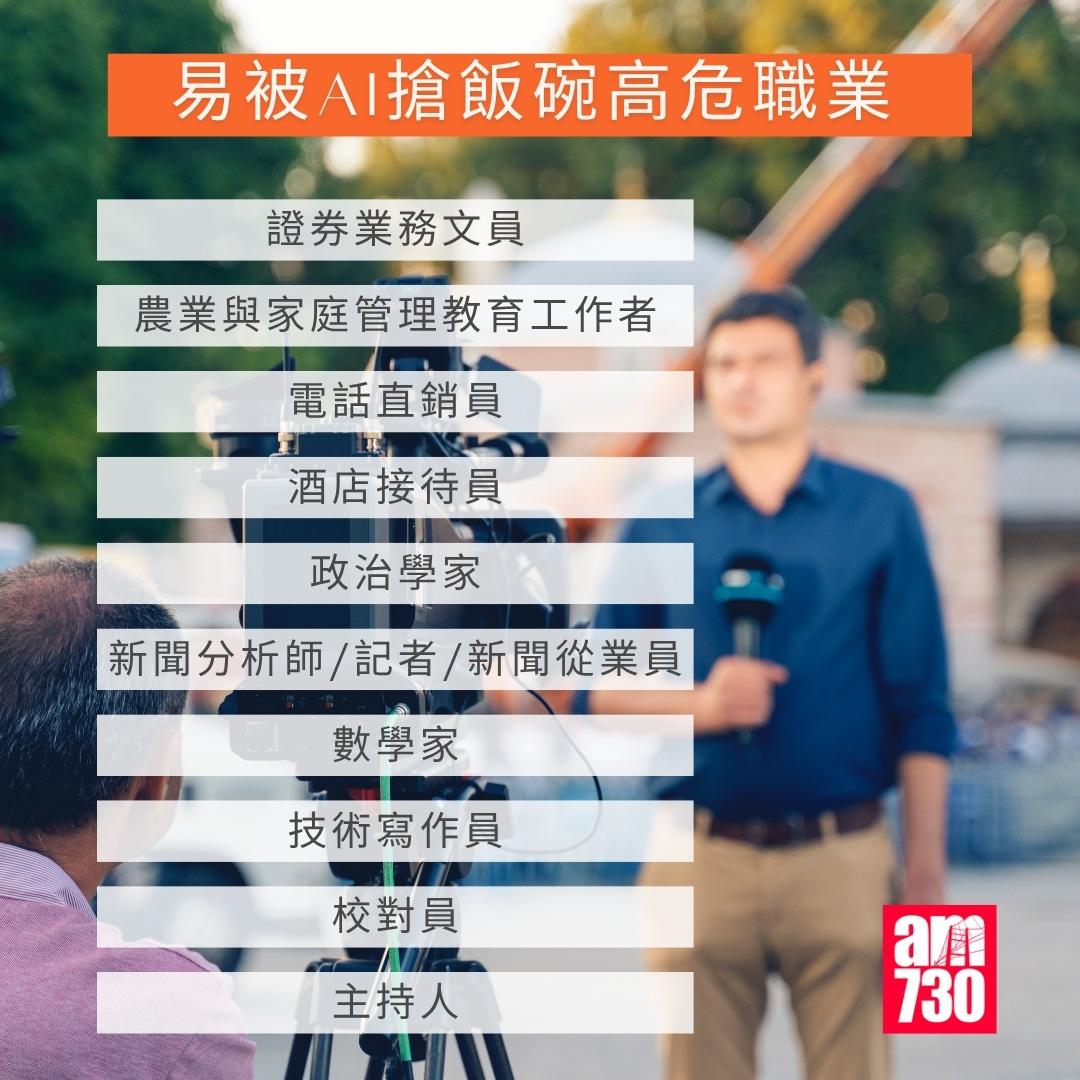

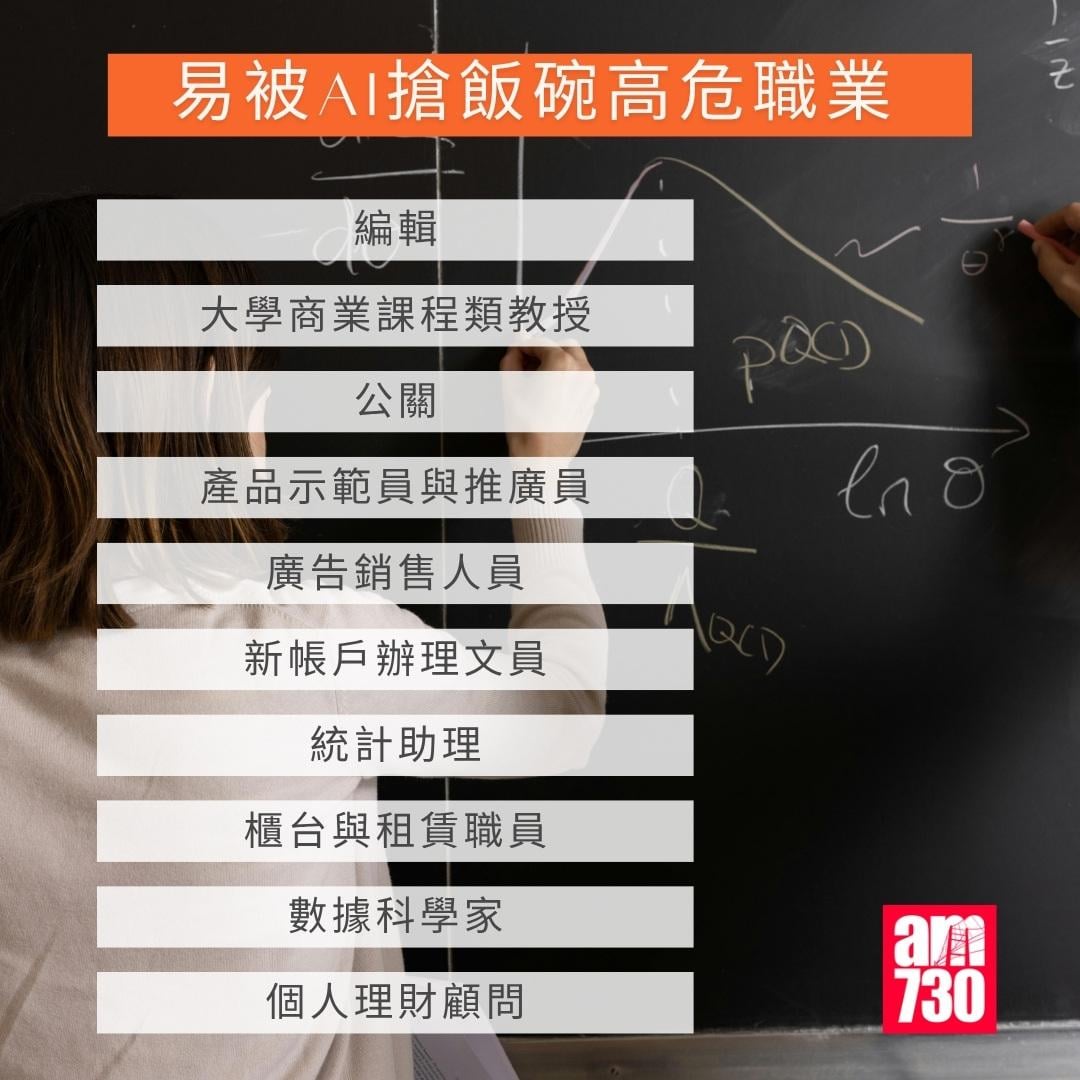

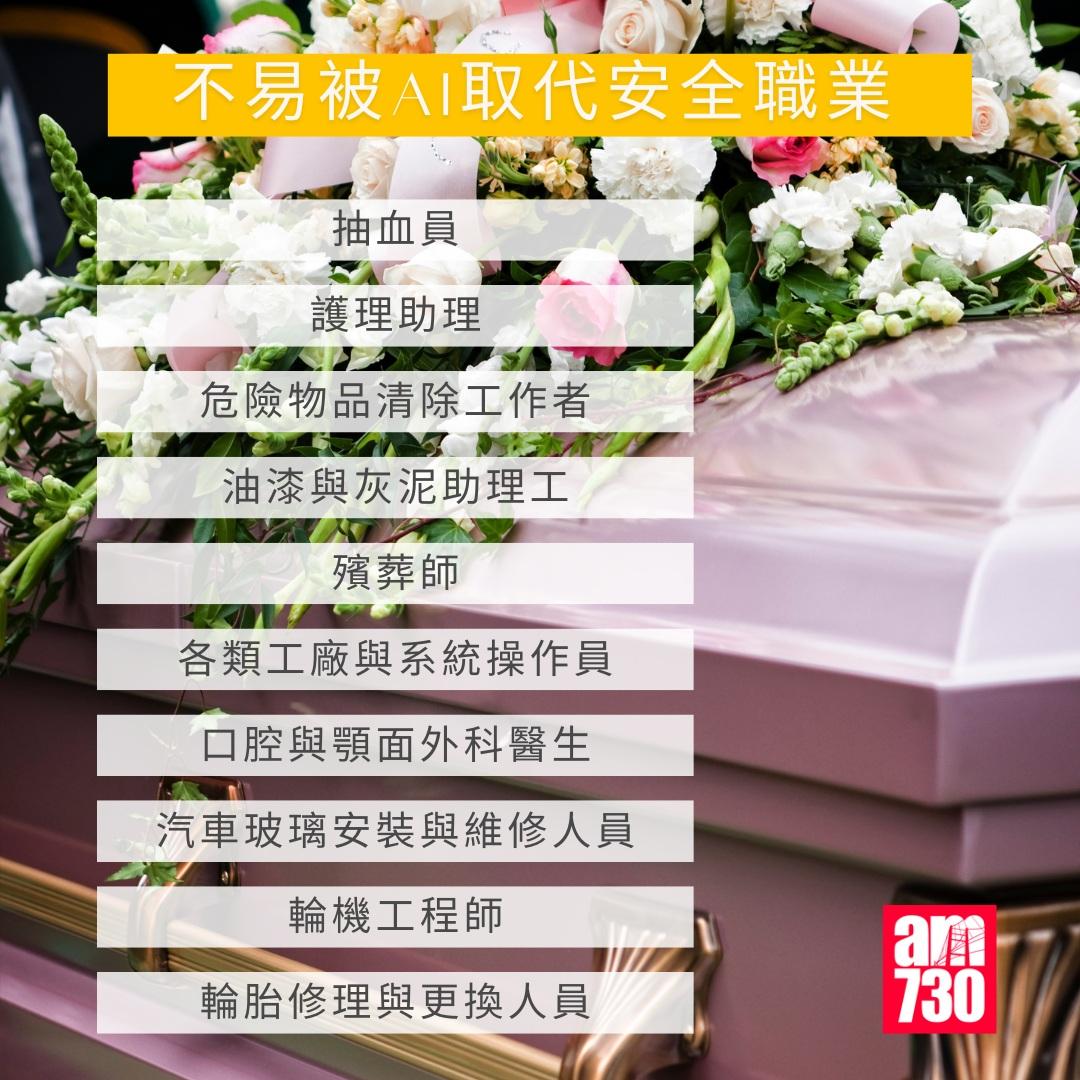

有人可能會關心被AI搶飯碗,多過自己的心理狀態,但兩者其實息息相關。美國AI教育公司Section 4的CEO肖夫(Greg Shove)預測,未來10年,使用AI的知識型僱員,將分為兩類群體:「AI乘客」(AI passengers)及「AI駕駛者」(AI drivers)。

「AI乘客」欣然把自己的認知工作,全權交由AI打理,短期內或因工作效率提升而獲得認可。但隨著AI能力愈趨進步,這些人終將被AI取代。至於「AI駕駛者」則堅持自己為主、AI為副,把AI生成的內容當作初稿,並作嚴格核查,有時甚至索性關閉AI,自己獨立思考。

人們應建立「AI緩衝帶」

陳楸帆提出,人們應有意識地建立「AI緩衝帶」——在面對新問題時,先從自己角度給出答案,再交由AI深化擴充,「我們甚至還可進行『對抗性生成』,即當AI給出跟自己觀點十分契合的答案時,應有批判性思維去質疑,到底是我被AI所影響,還是AI在我的不斷訓練下,變得越來越趨同?」